Stop curenju: Kako se osigurava AI bezbednost podataka

Ekran je postao crn, a hladan znoj mi se slivao niz potiljak dok sam gledao kako se gigabajti mojih klijentskih podataka ‘prelivaju’ na servere za koje nisam ni znao da postoje. Bilo je to 2 ujutro, a osjećaj je bio identičan onom kada vam pukne cijev u zidu – nemoć dok vaša najvrednija imovina nepovratno odlazi u odvod. Ako koristite vještačku inteligenciju bez striktnih pravila, vi ne koristite alat; vi bušite rupe u svom digitalnom trupu. Do kraja ovog vodiča naučićete kako da ‘zakrpite’ ove rupe, instalirate lokalne barijere i uštedite hiljade eura koje bi inače otišle na kazne za kršenje privatnosti ili industrijsku špijunažu.

Zašto je vaš API ključ kao napukla vodovodna cijev

Vaš API ključ nije samo lozinka; to je direktan ventil do vašeg novčanika i vaših podataka. Ako taj ventil ostavite otvorenim u javnom kodu, to je kao da ste ostavili ključ od kuće u bravi dok idete na godišnji odmor. Prvo pravilo u radionici: nikada ne ostavljajte alat tamo gdje ga svako može dohvatiti. Većina početnika pravi fatalnu grešku i hardkodira ključeve direktno u skripte. To će propasti. Kad-tad. Umjesto toga, koristite .env datoteke i sakrijte ih od verzije koda (git). Osjetite taj miris ozona koji dolazi iz preopterećenog servera? To je zvuk podataka koji cure jer niste postavili ‘rate limiting’. Svaki put kada vaš AI model pozove podatke, on otvara tunel. Ako taj tunel nije enkriptovan, hakeri će ga presresti kao što scrapperi skupljaju bakar iz starih instalacija. Provjerite enkripciju u 2026 kako biste razumjeli nove standarde koji su postali obavezni.

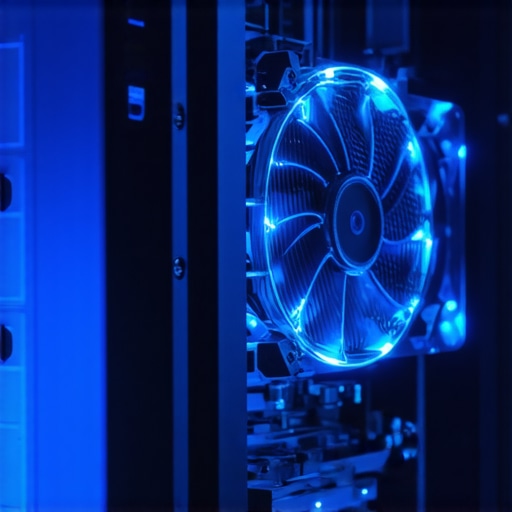

Lokalni LLM: Vaš privatni podrum bez pristupa internetu

Ako želite apsolutnu sigurnost, morate prestati slati podatke u ‘cloud’ tuđih kompanija. Cloud je samo tuđi računar, a taj računar može biti hakovan. Rješenje je da instalirate AI na svoj PC. To je digitalni ekvivalent kopanju vlastitog bunara umjesto spajanja na gradski vodovod. Može biti teško, vaša grafička karta će zujati kao stara cirkularna pila, a toplota iz kućišta će vas podsjetiti na ljetni dan u radionici, ali podaci nikada ne napuštaju vašu sobu. Koristite alate poput LM Studio ili Ollama. Ovdje nema magije, samo sirovi bakar i silicijum koji rade za vas. Ne trebaju vam ‘fancy’ oblaci ako imate dovoljno RAM-a da pokrenete Llama 3 ili Mistral modele lokalno.

WARNING: Nikada ne pokrećite neprovjerene ‘weights’ modele sa sumnjivih foruma bez prethodnog skeniranja. Zlonamjerni kod može biti ubačen direktno u tenzore modela, što omogućava napadaču da preuzme kontrolu nad vašim cijelim sistemom čim učitate model u memoriju (RAM). 120v strujni udar je ništa naspram gubitka root pristupa vašem serveru.

Anatomija katastrofe: Kako smo izgubili 40GB podataka zbog jednog ‘prompta’

Prošle godine, jedan moj kolega je u ChatGPT ubacio kompletnu bazu podataka firme kako bi ‘očistio’ formatiranje. Big mistake. Onog momenta kada je pritisnuo Enter, ti podaci su postali dio trening seta za buduće modele. Šest mjeseci kasnije, konkurentska firma je dobila slične prijedloge dizajna jednostavnim upitima. To je ‘tiho curenje’. Ako već morate koristiti javne servise, morate znati kako da isključite opcije treniranja. To nije opcija; to je preživljavanje.

Zašto enkripcija ‘na mirovanju’ (At Rest) često zakaze

Mnogi misle da su sigurni jer im je disk enkriptovan. To je zabluda. Ako je vaš AI model ‘budan’ i učitava bazu podataka u memoriju, podaci su ranjivi u RAM-u. To je kao da imate blindirana vrata na radionici, ali su prozori od običnog stakla. Morate implementirati ‘Confidential Computing’ ili barem osigurati da se vaši privremeni fajlovi (temp files) brišu odmah nakon procesiranja. Ako ostavite gunk u sistemu, on će postati meta. Kao što čistite piljevinu nakon svakog rezanja da se ne bi zapalila, čistite i digitalne tragove.

Pravna omča: Zašto vas ‘Responsible AI’ spašava zatvora

Nije samo stvar u tome da vas ne hakuju; stvar je u tome da vas ne tuže. Zakoni u 2026. su postali nemilosrdni prema onima koji nemaju jasno dokumentovan put podataka. Ako ne znate gdje vaši podaci idu, vi ste pravno odgovorni. Edukujte se o tome kroz pravne i sigurnosne aspekte AI. Ne dozvolite da vas birokratija uhvati nespremne dok vi pokušavate da inoviraš. Dokumentujte svaki API poziv. Svaki.

Zaključak koji to nije: Ostanite prljavi, ostanite sigurni

Sigurnost podataka nije destinacija, to je proces održavanja. To je kao podmazivanje mašina u radionici. Ako prestanete, sistem će zaribati. Nemojte vjerovati marketinškim obećanjima o ‘apsolutnoj sigurnosti’. Vjerujte samo kodu koji vidite, enkripciji koju sami kontrolišete i lokalnim modelima koje ste sami podesili. Slather na enkripciju, gurnite te ključeve duboko u sigurne trezore i ne dozvolite da vaš rad iscuri u tuđe ruke. Radite naporno, ali štitite svoj trud još jače.

Ova tema sigurnosti AI-jem je zaista ključna, posebno kada se osvrnemo na slučajeve gubitka podataka i curenje informacija. Lično sam nedavno počela koristiti lokalne modele na privatnom serveru, jer je to mnogo sigurnije nego oslanjanje na cloud usluge, pogotovo za osjetljive projekte. Takođe, bilo je zanimljivo čuti da mnogi greške u upotrebi API ključeva mogu biti fatalne, pa je skrivanje ključeva u .env fajlovima svakako prvi korak ka sigurnosti. Šta mislite, koliko su praktična rešenja za većinu manjih firmi, koje nemaju resurse za kompleksnu zaštitu, a ipak žele da sačuvaju podatke? I koje bi još savjete dodali za održavanje sigurnosti u svakodnevici rada s AI-jem?