Kako RNN mreže rade? Nauči osnove uz ovaj primer [DIY]

Zaboravi magiju: Zašto je tvoj AI model samo niz zarđalih zupčanika s pamćenjem

Prestani vjerovati marketinškim lažima da je AI neka vrsta digitalnog mozga koji ‘razmišlja’. To je gomila statike. Ako misliš da neuronska mreža razumije tvoju rečenicu kao ljudsko biće, u velikoj si zabludi. Obične neuronske mreže su kao tvoj stari komšija koji zaboravi tvoje ime čim zatvoriš vrata. Ti trebaš nešto što pamti. Tu na scenu stupaju Recurrent Neural Networks (RNN). One nisu magija; one su mehanizam povratne sprege, sličan onom starom termostatu u tvojoj radionici koji ‘zna’ kolika je temperatura bila prije pet minuta da bi odlučio hoće li upaliti grijanje sada. Ako želiš shvatiti osnove AI i mašinskog učenja, moraš zaprljati ruke matematikom koja stoji iza ovog zupčanika.

Anatomija RNN-a: Zašto obične mreže ‘zaboravljaju’ ono što je bitno

Standardne mreže rade na principu ‘unutra-van’. Ubaciš sliku mačke, dobiješ oznaku ‘mačka’. Kraj priče. Ali šta ako analiziraš video ili tekst? Tu je bitan redoslijed. Ako pročitaš riječ ‘ne’, pa ‘radi’, to je potpuno drugačije od ‘radi’, pa ‘ne’. RNN radi tako što uzima izlaz iz prethodnog koraka i ‘gura’ ga nazad u ulaz sljedećeg koraka. To je kao da slapaš slojeve ljepila jedan na drugi – svaki novi sloj se drži za onaj ispod. Osjeti taj miris sintetike u kodu. To je miris podataka koji imaju kontinuitet. Bez toga, tvoj AI je samo skupi digitron koji nagađa. Da bi sve ovo radilo bez pucanja, moraš znati kako podesiti neurone bez greške koristeći prave funkcije aktivacije.

Zašto tvoj model ‘halucinira’ nakon 10 minuta?

Problem je jednostavan: memorija blijedi. U svijetu RNN-a, to zovemo ‘Vanishing Gradient’. Zamisli da pokušavaš prenijeti poruku kroz deset ljudi šapućući. Do desetog čovjeka, poruka je besmislena buka. Vaš gradijent, koji služi kao signal za učenje, postane toliko mali da se neuroni prestanu ažurirati. To je kao da pokušavaš zategnuti vijak koji je potpuno oguljen. Možeš okretati do sutra, ali ništa se ne dešava. Model se zaglavi. Ako se ne paziš, završićeš sa sistemom koji daje potpuno sulude odgovore. Saznaj više o tome zašto tvoj AI model laže i kako to spriječiti prije nego što pustiš kod u produkciju.

UPOZORENJE: Ne pokreći dugačke RNN sekvence na starom laptopu bez nadzora temperature. Procesor će se usijati, a ventilatori će zvučati kao mlazni motor prije nego što sistem ‘zakuca’. 120 stepeni na jezgru nije šala – možeš trajno oštetiti silicijum.

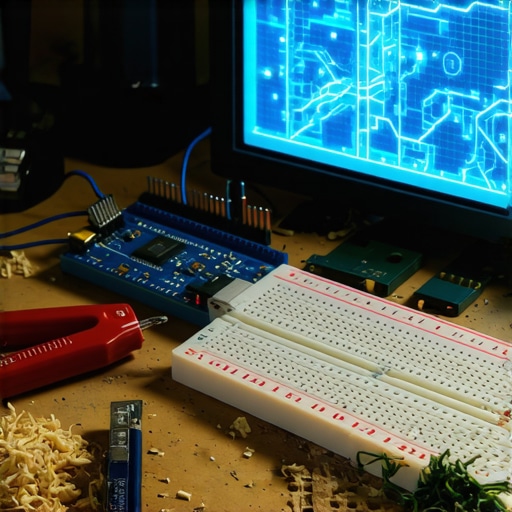

DIY Primjer: Predviđanje temperature u tvojoj garaži

Hajde da budemo praktični. Recimo da imaš senzor koji bilježi temperaturu svaka dva sata. Želiš predvidjeti hoće li sutra u 8 ujutro tvoj alat biti prekriven mrazom. Običan algoritam bi gledao samo zadnju cifru. RNN gleda trend zadnja tri dana. On ‘osjeća’ kako hladnoća nadire kroz pukotine na vratima. Prvi korak je normalizacija podataka. Ne možeš hraniti mrežu sirovim brojevima od -10 do +40. To je kao da pokušavaš ugurati kvadratni klin u okruglu rupu. Moraš to skalirati između 0 i 1. Zatim, definišeš ‘skriveno stanje’ (hidden state). To je tvoja memorija. Svaki put kad novi podatak uđe, skriveno stanje se ažurira. Ako želiš ozbiljan rad, razmisli o tome da pokreneš lokalni LLM koji već koristi naprednije verzije ovih principa.

The Anatomy of a Screw-Up: Katastrofa sa dugim sekvencama

Napravio sam grešku 2024. godine pokušavajući da RNN-om analiziram cijelu knjigu odjednom. Rezultat? Model je počeo ponavljati riječ ‘i’ beskonačno. Zašto? Zato što je RNN po prirodi kratkovidan. On se sjeća šta je bilo prije pet sekundi, ali pojma nema šta je bilo na početku poglavlja. Ako tvoj projekat zahtijeva pamćenje duže od par rečenica, obični RNN će te iznevjeriti. Puknuće kao loša daska pod prevelikim teretom. Rješenje je prelazak na LSTM (Long Short-Term Memory) koji ima ‘kapije’ za zaboravljanje. To je kao da imaš filter u radionici koji propušta samo finu piljevinu, a krupne komade izbacuje. Bez tih kapija, tvoj model postaje deponija beskorisnih informacija.

Da li mi stvarno treba RNN u 2026?

Kratak odgovor: Zavisi. Ako radiš sa senzorima u realnom vremenu ili jednostavnim tekstualnim komandama, RNN je i dalje kralj efikasnosti. Ali ako pokušavaš napraviti nešto što piše poeziju, zakasnio si – transformeri su preuzeli taj teren. Ipak, razumijevanje RNN-a je kao učenje kako radi motor sa unutrašnjim sagorijevanjem prije nego što sjedneš u Teslu. Moraš znati gdje su ventili. Ne budi jedan od onih ‘copy-paste’ inženjera. Shvati trenje, shvati gradijent, i tek onda pokreni skriptu. To je jedini način da postaneš pravi majstor zanata u svijetu vještačke inteligencije.