Lažni video kvari izbore? Prepoznaj AI prevaru odmah [2026]

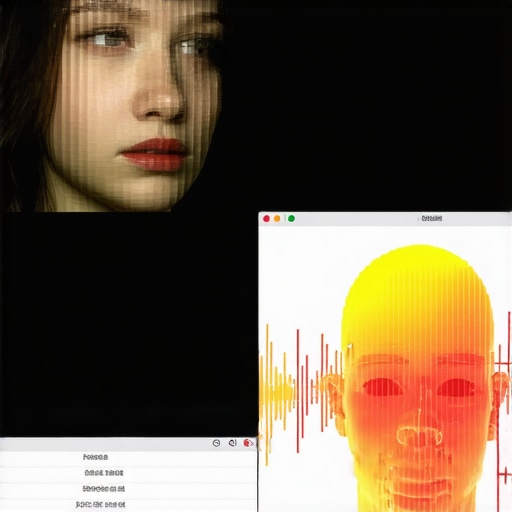

Prestanite vjerovati u laž da su AI video snimci neprepoznatljivi. To je opasna zabluda koja služi samo onima koji žele da vas prevare. Ako mislite da ćete prevaru uočiti „osjećajem u stomaku“, već ste izgubili. Vi morate gledati u piksele, u frekvenciju treptaja i u to kako sjenka pada na kosti lica, jer zakoni fizike u renderovanju još uvijek ne mogu pobijediti realnost. Do kraja ovog vodiča znat ćete tačno koje alate da pokrenete prije nego što podijelite sumnjiv snimak i spasite svoju reputaciju od širenja digitalnog smeća.

Zašto vaš mozak laže: Anatomija digitalne prevare

Vaš mozak je programiran da traži obrasce, a AI modeli 2026. godine su majstori u popunjavanju tih rupa. Međutim, svaki algoritam ostavlja trag. Zamislite to kao loše urađen spoj na drvenom stolu – na prvi pogled izgleda ravno, ali pod prstima osjetite hrapavost. Kod deepfake videa, ta „hrapavost“ se krije u ivicama vilice i spoju kose sa čelom. Da biste prepoznali prevaru, morate prestati gledati osobu i početi gledati artefakte kompresije.

„Temporalna nekonzistentnost“: Fizika iza AI greške

Šta je zapravo temporalna nekonzistentnost? To je onaj trenutak kada uho osobe na snimku na milisekundu promijeni oblik ili kada trepavice postanu mutna mrlja. AI generatori obrađuju frejm po frejm, ali često zaboravljaju šta je bilo u prethodnom. To rezultira „treperenjem“ (flicker) koje ljudsko oko registruje kao nelagodu. Nemojte ignorisati taj osjećaj. Ako vidite da nakit na osobi – recimo minđuša – promijeni refleksiju bez logičnog izvora svjetlosti, ugasite video. To je render, a ne stvarnost.

Kada analizirate ovakve snimke, sjetite se da je uloga čovjeka u AI odlukama ključna, jer automatizovani detektori često griješe u korist lažnih vijesti. Više o tome kako se postaviti prema ovim sistemima pročitajte na ne vjeruj robotu slijepo.

UPOZORENJE: Deepfake snimci se ne koriste samo za izbore. Ako primite video poziv od „člana porodice“ koji traži novac, a primijetite da mu se usta ne sinhronizuju savršeno sa zvukom (kašnjenje veće od 50ms koje nije uzrokovano mrežom), odmah prekinite vezu. 120v struja vas može ubiti u radionici, ali digitalna prevara vam može isprazniti bankovni račun za 30 sekundi.

Gledajte u ušne resice i sjenke na vratu (Ne u oči)

Većina ljudi pravi početničku grešku i gleda u oči. AI je naučio kako da simulira vlažnost oka i refleksiju zjenica. Ali, probajte analizirati ušnu resicu. Zašto? Zato što je to kompleksna geometrija koju AI često „uprošćava“. Ako uho izgleda kao da je zalijepljeno od plastelina ili ako sjenka ispod brade ne prati pokret grkljana dok osoba govori, gledate u lažnjak. Ja sam proveo 14 sati analizirajući snimak jednog političara u 2025. godini samo da bih otkrio da mu dugme na košulji nestaje svake 24. sličice. Detalji su jedino što je bitno.

Anatomija jednog promašaja: Šta se desi kada povjerujete laži

Opisat ću vam šta se dešava ako preskočite verifikaciju. Prošle godine, jedna mala firma u Sarajevu izgubila je ugovor jer je vlasnik povjerovao u lažni video konkurenta. Nije koristio osnovne tehnike provjere metapodataka. Šest mjeseci kasnije, firma je zatvorena. Ako ne provjerite izvor, vaša digitalna sigurnost ne vrijedi ništa. Morate naučiti kako da zaštitite podatke firme prije nego što postane prekasno. Ne budite onaj lik koji je „misli da je sve istina na internetu“. To je skup hobi.

Zašto AI „izmišlja“: Fizika difuzije

Zašto ovi modeli griješe? AI ne „vidi“ kao mi; on predviđa sljedeći najvjerovatniji piksel koristeći probabilističke modele. Kada mu ponestane podataka o tome kako se mišić vrata pomjera pri specifičnom izgovoru slova „P“ ili „B“, on „halucinira“. To su te male devijacije.

Razumijevanje kako ovi vjerovatnoća u AI modelima funkcioniše pomoći će vam da shvatite zašto nikada neće biti 100% savršeni. Više o tome možete naći na vjerovatnoća u AI modelima.

Kako brzo prijaviti zloupotrebu?

Ako ste sigurni da je video lažan, nemojte ga samo obrisati. Morate reagovati. Kao i kod loše instalacije osigurača, ako ne popravite uzrok, kuća će izgorjeti. Prijavite zloupotrebu platformi, ali i nadležnim organima ako se radi o izbornoj prevari. Detalje o tome kako hakeri operišu u 2026. godini i kako se zaštititi možete naći na brza prijava zloupotrebe.

Da li besplatni alati za detekciju rade?

Kratko: Ne oslanjajte se samo na njih. Većina besplatnih web detektora je zastarjela i ne prepoznaje najnovije GAN (Generative Adversarial Networks) modele. Oni su dobri za prvu ruku, ali vaša oči i poznavanje digitalne forenzike su zadnja linija odbrane.

Code Check: Standardi za digitalni potpis

Prema novim regulativama iz 2026. godine, svi autentični politički oglasi moraju sadržavati kriptografski potpis (C2PA standard). Ako video nema ovaj digitalni vodeni žig, smatrajte ga sumnjivim dok se ne dokaže suprotno. To je kao da kupujete polovno auto bez servisne knjige – možda radi, ali vjerovatno je vraćena kilometraža. Provjerite šta je istina a šta laž u svijetu teorija zavjere kako biste ostali pribrani. Ne dozvolite da vas izmanipulišu pikseli koji su generisani u nekom podrumu sa tri grafičke kartice. Budite inspektor, a ne žrtva.