Brza obrada teksta: Spremno za ML za manje od sat vremena

Sat vremena rada senior ML inženjera u 2026. godini košta oko 150 KM, dok zakup GPU klastera za trening loše pripremljenih podataka može pojesti 2.000 KM prije nego što uopšte popiješ prvu kafu. Ako misliš da će tvoj model ‘magično’ shvatiti šta znači ili pogrešno enkodiran UTF-8 karakter, varaš se. Podaci nisu ‘novo ulje’ – oni su sirova, prljava ruda koju moraš istući čekićem i spržiti u peći da bi dobio čisto zlato. U ovom vodiču nećemo mlatiti praznu slamu; pokazat ću ti kako da očistiš 10 GB teksta koristeći Python i par sirovih trikova dok ti se procesor još nije ni zagrijao.

Zašto ti treba Python hirurgija, a ne gotovi alati

Zaboravi na skupe platforme koje obećavaju ‘čišćenje podataka u tri klika’. To je marketing za menadžere. Tebi treba kontrola. Kada pokreneš skriptu, moraš osjetiti kako procesor ‘grize’ podatke. Ako koristiš pogrešnu biblioteku, tvoj RAM će eksplodirati brže nego stari bojler pod pritiskom. Pandas je odličan za tabele, ali za sirovi tekst od par gigabajta, on je trom i neefikasan. Tu uskače Regex (regularni izrazi) – alat koji je toliko moćan koliko je i opasan. Jedan pogrešan karakter u tvom Regex obrascu i obrisat ćeš svaku tačku u rečenici, pretvarajući svoj dataset u beskorisnu kašu.

WARNING: Nikada ne pokreći destruktivne skripte na originalnim fajlovima. Jedan pogrešan ‘rm -rf’ ili loše napisan ‘write’ mod u Pythonu i tvoj višesedmični rad na prikupljanju podataka nestaje u nanosekundi. 120v šoka te neće ubiti kao gubitak klijentskih podataka.

Anatomija katastrofe: Greška sa enkodiranjem koja ubija modele

Imao sam situaciju prošlog utorka. Dataset od pola miliona komentara sa balkanskih portala. Na prvi pogled sve izgleda super, ali model izbacuje totalne gluposti. Zašto? Zato što je neko miješao Windows-1250 i UTF-8. Za računar, slovo ‘č’ nije isto što i ‘è’. Ako tvoj pipeline ne prepozna ovu razliku, tvoj model će učiti da su to dva različita pojma. To je kao da pokušavaš sastaviti motor koristeći šarafe sa milimetarskim i inčnim navojem istovremeno. Neće ići. Struži te podatke dok ne ostanu samo čisti bajtovi. Koristi biblioteke poput chardet da identifikuješ smeće prije nego što ga ubaciš u bazu. Osjetit ćeš miris ‘digitalnog ozona’ kada tvoj procesor napokon počne procesirati čiste nizove bez zastajkivanja na svakom čudnom karakteru.

Čišćenje nije samo brisanje; to je precizno odstranjivanje viška. Zamisli da klešeš statuu iz bloka mramora. Sve što nije dio tvoje buduće AI arhitekture mora ići van. HTML tagovi, višestruki razmaci, specijalni karakteri – to je sve balast koji usporava učenje. Brzi rad zahtijeva automatizaciju, ali automatizaciju sa ljudskim nadzorom.

Zašto ovo zapravo radi? Fizika stringova u memoriji

Kada kažemo ‘obrada teksta’, mi zapravo manipulišemo memorijskim adresama. Python stringovi su ‘immutable’, što znači da svaka promjena kreira novi string u memoriji. Ako imaš milion rečenica i na svakoj radiš .replace(), tvoj RAM će se napuniti brže nego kanta pod puknutom cijevi. ‘Why It Works’ caka: Koristi generatore i mapiranje. Umjesto da učitaš cijeli fajl, procesiraj ga liniju po liniju. To je razlika između pokušaja da popiješ cijelo bure vode odjednom i pijenja kroz slamku. Rezultat je isti, ali tvoj stomak (ili RAM) neće puknuti.

The Anatomy of a Screw-Up: Dan kada je Regex pojeo bazu

Najveća greška koju možeš napraviti je pretjerano pouzdanje u automatizaciju bez testiranja na malom uzorku. Jedan klijent je pokušao očistiti email adrese iz dataseta koristeći previše agresivan Regex. Rezultat? Obrisao je i svaku domenu koja je završavala na .com, .net i .org unutar samog teksta jer je pravilo bilo preširoko. Šest mjeseci kasnije, otkrili su da njihov model za klasifikaciju vijesti uopšte ne razumije linkove jer su svi bili ‘osakaćeni’. Popravka je koštala tri puta više nego prvobitna obrada. Nauči lekciju: Uvijek provjeri prvih 100 i zadnjih 100 redova nakon svake operacije. Ručno. Oči će te boljeti, ali tvoj novčanik neće.

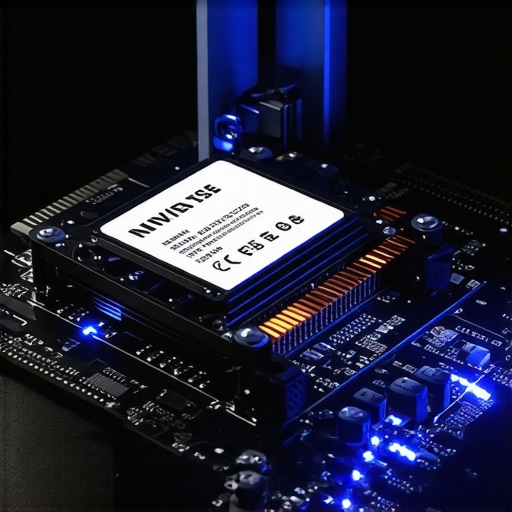

Koji alat zapravo kupiti? (Hint: Nijedan)

Ne kupuj ‘AI data cleaning’ softvere koji koštaju 50 dolara mjesečno. To je bačen novac. Sve što ti treba je solidan terminal, Python i poznavanje NLTK ili SpaCy biblioteka. Ako baš želiš trošiti, kupi bolji NVMe disk. Brzina čitanja i pisanja (I/O) je usko grlo kod obrade velikih tekstualnih fajlova. Čitanje sa starog HDD-a je kao da pokušavaš napuniti bazen kašičicom. Uzmi Samsung 990 Pro ili sličan disk i osjetit ćeš kako skripte prosto lete kroz fajlove. Zaboravi na fensi interfejse; pravi majstori rade u crnom prozoru sa bijelim slovima.

Zaključak: Sat otkucava

Imaš 55 minuta. Prvih 10 trošiš na analizu enkodiranja. Sljedećih 20 na pisanje i testiranje Regex pravila. 15 minuta za masovno procesiranje kroz sve jezgre procesora (koristi multiprocessing modul, ne budi lijen). Zadnjih 10 minuta provjeri rezultate. Ako vidiš čiste rečenice, bez ‘junk’ karaktera, spreman si za ML. Podaci su sada flush-mounted, utegnuti i spremni za trening. Ne gubi vrijeme na dotjerivanje estetike koda; bitno je da radi brzo i da ne kvari podatke. Sad se baci na posao i nemoj da te opet uhvatim kako ručno brišeš zareze u Excelu.