Da li tvoj AI laže? Kako provjeriti kvalitet odgovora

Digitalna rđa i lažna obećanja: Zašto tvoj AI ‘puca’ pod pritiskom

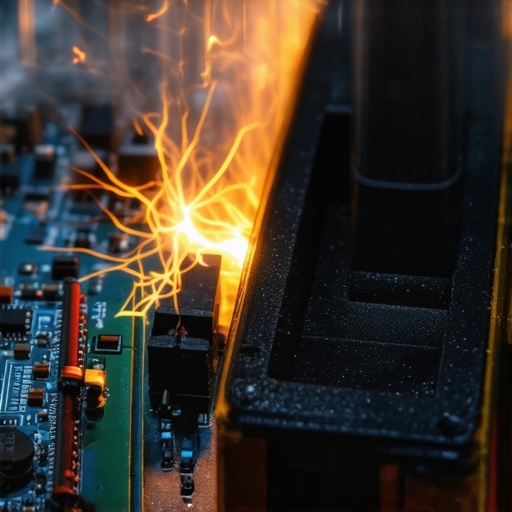

Prestanite vjerovati da je ChatGPT vaš nepogrešivi digitalni asistent. To je marketinška laž koja će vam uništiti kredibilitet ili spržiti kod brže nego što loš osigurač sprži instalaciju. AI ne ‘razmišlja’; on pogađa sljedeću riječ na osnovu vjerovatnoće. Ako niste spremni da svaki odgovor provjerite kao što provjeravate nosivost grede prije nego što na nju stavite krov, nemojte ga ni koristiti. Vi ste ti koji držite alat, a ako je alat kriv, vi ste krivi što ga niste kalibrisali. Vaš zadatak je da prepoznate trenutak kada model počne da ‘halucinira'—što je samo ljepši izraz za čistu, nepatvorenu laž upakovanu u savršenu gramatiku.

Prva stvar koju morate shvatiti je da AI modeli imaju tendenciju da budu ‘ugodni’ (agreeable). Oni žele da vam daju odgovor čak i kada ga nemaju. To je kao onaj šegrt u radionici koji klima glavom dok mu objašnjavate kako da koristi glodalicu, a zapravo nema pojma šta radi. Rezultat je isti: uništen materijal i izgubljeno vrijeme. Vaš multimetar za istinu ovdje su unakrsna pitanja i specifični testovi logičkog napona koje ćemo sada proći.

Multimetar za istinu: Kako testirati logički napon odgovora

Da biste znali da li vas bot laže, morate ga natjerati da pokaže svoj rad. Nemojte samo tražiti rezultat; tražite proces. Kada mu zadate kompleksan zadatak, zahtijevajte ‘chain-of-thought’ proces. Ako AI ne može objasniti korake bez kontradikcija, odgovor je smeće. Bacite ga. Koristite tehniku ‘nulte tolerancije’ na nejasne termine. Svaki put kad upotrijebi riječ ‘vjerovatno’ ili ‘često’, pritisnite ga za konkretne brojeve ili izvore.

Da li AI zapravo može lagati?

Ne u ljudskom smislu, ali može generisati ‘sintetičku neistinu’. On nema moralni kompas; on samo prati statističku putanju. Ako su podaci na kojima je treniran bili ‘rđavi’, i rezultat će biti takav. To je čista fizika informacija. Ne možete dobiti čist rez sa tupom pilom, niti možete dobiti tačan pravni savjet od modela koji je treniran na forumima iz 2012. godine.

Zašto ne smiješ vjerovati ‘nuli’ i ‘jedinici’ bez provjere (Fizika logike)

Zamislite da miješate dvokomponentni epoksid. Ako promašite omjer za samo 2%, smjesa se nikada neće stvrdnuti. Postat će ljepljivi nered koji uništava sve što dotakne. Slično je sa AI promptovima. Jedna pogrešna instrukcija i cijela logička struktura se ruši.

WARNING: Nikada ne unosite povjerljive podatke o klijentima ili sigurnosne ključeve u javne AI modele. To je kao da ostavite ključeve radionice na izlogu sa natpisom ‘slobodno uđite’. Vaša privatnost će ispariti u milisekundi.

U svijetu mašinskog učenja postoji termin ‘temperatura’. To nije toplota koju osjećate dok procesor zuji pod vašim dlanom, već parametar kreativnosti. Što je temperatura viša, model više ‘mašta’. Za tehničke upute, temperatura mora biti blizu nule. Ako osjetite da AI počinje cvjetno opisivati rješenja, on zapravo samo pokušava sakriti nedostatak činjenica. Zgrabite taj odgovor, ogulite te opise kao staru farbu i vidite šta je ostalo ispod. Često ne ostane ništa.

Anatomija provale: Kako je jedan pogrešan prompt srušio projekt

Prije šest mjeseci, vidio sam ‘stručnjaka’ koji je koristio AI da izračuna statičko opterećenje za jednu malu platformu. AI je pogriješio u decimali. Model je bio toliko samouvjeren da korisnik nije ni provjerio računicu. Srećom, platforma je pukla pri testiranju vrećama pijeska, a ne pod čovjekom. To je bila lekcija iz poniznosti pred mašinom. Problem nije bio u AI-u, već u tome što korisnik nije koristio metodu ‘triangulacije’.

Triangulacija znači da isti problem postavite tri puta na tri različita načina. Ako dobijete tri različita rezultata, model se ‘znoji’. To je jasan znak da ne zna odgovor već ga konstruiše u letu. AI je tada kao stari motor koji troši ulje—izgleda da radi, ali će vas ostaviti na cesti kada vam bude najpotrebnije. Morate biti grubi prema njemu. Natjerajte ga da se brani. Pitajte ga: ‘Zašto je ovaj odgovor pogrešan?’ i gledajte kako se koprca. To je trenutak istine.

Alatnica za provjeru: Metrike koje ignorišeš

Većina ljudi samo gleda da li tekst ‘zvuči’ dobro. To je greška početnika. Morate pratiti specifične metrike kao što je ‘Perplexity’ (koliko je model zbunjen vašim pitanjem) i ‘Consistency Score’. Postoje alati koji to rade automatski, ali vi to možete uraditi ručno. Ako mu zadate da napiše kod, odmah ga gurnite u kompajler. Nemojte ga samo čitati. Pokrenite ga. Jamite taj kod u okruženje i gledajte gdje varniči. Ako baci grešku, nemojte tražiti od AI-a da je popravi odmah; prvo ga pitajte zašto je do greške došlo. Razumijevanje kvara je važnije od krpljenja rupe.

Vaša armatura ovdje je Python. Naučite bar osnove da biste mogli pisati skripte koje validiraju AI izlaze. To je kao da imate digitalno pomično mjerilo. Bez toga, vi samo nagađate. A nagađanje u profesionalnom radu je put u propast. Slather (namažite) svoje promptove strogim pravilima: ‘Bez pridjeva, samo podaci, citiraj izvore, koristi ISO standarde’. Što više ograničite njegovu ‘maštu’, to će rezultat biti čvršći.

Zašto se AI ‘znoji’ kod kompleksnih kalkulacija (The Struggle)

Gledati AI kako pokušava riješiti kompleksnu matematiku je kao gledati nekoga ko pokušava podići klavir bez pojasa za leđa. Vidite napor, vidite drhtanje, i znate da će nešto puknuti. Modeli gube nit kod dugih sekvenci jer im ‘kontekstni prozor’ postane pretrpan smećem. Vaš posao je da čistite to smeće. Ako razgovor traje predugo, započnite novi. Resetujte ga. Očistite radnu površinu baš kao što brišete piljevinu sa stola prije novog reza.

Bit ćete umorni od stalnog provjeravanja. Vaš mozak će željeti da samo klikne ‘copy-paste’. Nemojte. To je trenutak kada digitalna rđa ulazi u vaš rad. Izdržite. Provjerite svaku tvrdnju. Svaki link koji vam AI pošalje je vjerovatno mrtav ili vodi na pogrešnu stranicu. AI ‘izmišlja’ URL-ove jer oni statistički izgledaju kao pravi linkovi. To je vrhunac drskosti mašine, ali i vaš najveći test kao majstora svog zanata. Ako niste provjerili link, niste uradili posao.

Zašto itworks: Logika iza vjerovatnoće

Zašto ovi modeli griješe? Sve se svodi na ‘tokenizaciju’ i statističko mapiranje. Zamislite da imate ogromnu mapu svih riječi ikada napisanih. AI pokušava pronaći najkraći put između vašeg pitanja i odgovora. Ali najkraći put nije uvijek najsigurniji. Ponekad je prečica preko močvare. Model ne razumije uzročnost; on razumije samo korelaciju. On zna da riječ ‘kiša’ često ide uz riječ ‘mokro’, ali on ne zna šta je voda. On ne osjeća vlagu. On nema senzor za realnost. Zato ste vi tu. Vi ste senzor. Vi ste ti koji moraju reći: ‘Ovo nema smisla u stvarnom svijetu’. Bez ljudske validacije, AI je samo skupi generator nasumičnosti koji troši previše struje.