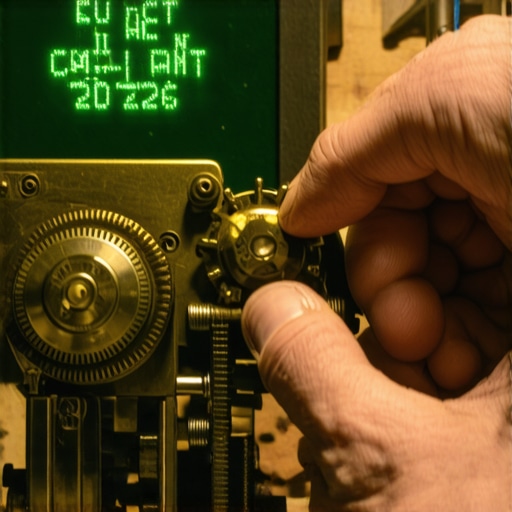

Izbegni kazne: Priprema za August 2026 AI zakon i pravila

35 miliona eura. Toliko iznosi kazna za kršenje EU AI zakona, a ti vjerovatno misliš da tvoj mali biznis nije na radaru. August 2026. će te demantovati ako tvoji algoritmi rade bez nadzora. Ako tvoja skripta za analizu kupaca donosi odluke bez ‘human-in-the-loop’ protokola, ti si u crvenoj zoni. Ovaj vodič nije teorija; ovo je tehnički nacrt za preživljavanje u novom regulatornom poretku. Do kraja ovog teksta, znat ćeš tačno koji osigurač trebaš izvući da ti firma ne izgori pod inspekcijskim nadzorom.

Klasifikacija tvojih alata: Gdje curi rizik

Instaliraj odmah jasnu tabelu svih AI alata koje tvoj tim koristi, od najobičnijeg chatbota do sistema za analizu podataka. Osjetit ćeš hrapavost papira pod prstima dok budeš popisivao te licence, a miris stare kafe će te pratiti dok shvatiš da polovina tvojih alata spada u kategoriju ‘visokog rizika’. EU zakon ne zanima da li si ti ‘htio’ najbolje; zanima ih da li tvoj softver diskriminiše ili manipuliše.

Da li moj chatbot stvarno treba ljudsku kontrolu?

Da, apsolutno. Bez čovjeka koji provjerava izlazne podatke, tvoj sistem je tempirana bomba. Zakon zahtijeva ‘human-in-the-loop’ (HITL) princip. To znači da tvoj radnik mora imati ‘kill-switch’ dugme za svaku odluku koju AI donese. Ako tvoj AI odlučuje ko dobija popust, a ko ne, i to radi na osnovu pristrasnih podataka, kazna će biti veća od tvog godišnjeg prometa.

WARNING: Nikada ne dozvoli AI sistemu da vrši biometrijsku identifikaciju u realnom vremenu na javnom mjestu. Prema članu 5. EU AI Act-a, ovo je strogo zabranjeno i vodi do direktnog zatvaranja operacija bez prava na žalbu.

Anatomija katastrofe: Kako se gubi sve u jednom popodnevu

Zamislite scenu: August je 2026. godine, sunce prži, a tvoj server zuji kao roj ljutih osa. Tvoj AI za regrutaciju, onaj koji si ‘podesio za 5 minuta’ koristeći stari model, počeo je odbijati kandidate na osnovu poštanskog broja. Ti to ne vidiš. Ali regulator vidi. U roku od šest mjeseci, tvoj inbox će biti zatrpan tužbama za diskriminaciju. Problem nije u kodu, nego u tvojoj lijenosti da uradiš audit. Ako preskočiš postavljanje ‘fairness’ testova, tvoj model će razviti predrasude brže nego što ti stigneš popraviti kafu. To je krtost sistema o kojoj niko ne priča. Bez validacije podataka (data governance), tvoj AI je samo skupo smeće koje te vodi u bankrot.

Zašto to radi: Mehanika neuronskih mreža i zakonska filtracija

Nije dovoljno reći ‘AI je pogriješio’. Moraš razumjeti zašto. AI modeli rade kao niz sitnih sita. Što je sitnije sito (više slojeva), to je rezultat precizniji, ali i teži za objasniti (tzv. black box). Regulatori u 2026. zahtijevaju ‘objašnjivost’. Ako ne možeš objasniti zašto je tvoj LSTM model predvidio pad cijena, tvoj model je nelegalan. To je kao da gradiš kuću bez projekta; možda će stajati, ali te niko neće pustiti da u njoj živiš. Moraš ugraditi mehanizme koji bilježe svaki korak odlučivanja. Slather (nabaci) sloj transparentnosti preko svakog algoritma. Koristi alate za detekciju halucinacija (hallucination checks) jer u svijetu zakona, izmišljena činjenica je direktna laž, a laž košta milione.

Audit koji radi: Provjeri sistem prije nego što to uradi Brisel

Uzmi multimetar za svoje podatke i počni mjeriti. Prvo, provjeri porijeklo svog skupa podataka (dataset). Ako si koristio ‘open source’ modele bez provjere licence, ti zapravo kradeš tuđi rad, a EU AI Act to kažnjava kroz zaštitu intelektualnog vlasništva. Drugo, postavi lokalni AI server ako želiš sačuvati privatnost klijenata. Slanje osjetljivih podataka na američke servere u 2026. godini je kao da ostavljaš novčanik na sred ulice. Instaliraj Stable Diffusion ili lokalni LLM i drži ključeve u svom džepu.

Mogu li koristiti besplatne alate za biznis?

Samo ako imaju certifikat o usklađenosti. Većina besplatnih alata koristi tvoje podatke za trening, što je direktno kršenje GDPR-a i novog AI zakona. Ako alat nema opciju ‘zero-retention’, bježi od njega glavom bez obzira.

Forenzička analiza neuspjeha: Slučaj ‘Puknutog algoritma’

Gledao sam to stotinu puta. Firma kupi skupi AI alat, ugradi ga u prodaju, i zaboravi na njega. Šest mjeseci kasnije, model počne da ‘driftuje’. To znači da podaci iz stvarnog svijeta više ne odgovaraju onome na čemu je model treniran. Rezultat? Cijene skaču bez razloga, kupci odlaze, a sistem počinje da ‘halucinira’ popuste koji ne postoje. To je kao da ostaviš drvenu konstrukciju na kiši bez zaštite—iskrivit će se. U 2026. taj ‘drift’ nije samo tvoj poslovni problem, to je zakonska odgovornost. Ako tvoj sistem postane nepredvidiv, ti si odgovoran za štetu. Zato je redovna re-evaluacija modela tvoja jedina polisa osiguranja.

Majstorski trikovi za August 2026.

Ne kupuj nove, skupe alate ako možeš nadograditi postojeće. Koristi Python skripte za ‘bias detection’ (otkrivanje pristrasnosti) koje možeš naći besplatno. Moj stari administrator Huso uvijek kaže: ‘Ako ne možeš popraviti čekićem, ne valja ti alat’. AI je isti. Ako ga ne možeš kontrolisati jednostavnim pravilima, previše je komplikovan za tvoj biznis. Smanji troškove tako što ćeš automatizovati samo procese niskog rizika, poput rasporeda radnih sati, a odluke o ljudima ostavi ljudima. To je najjeftiniji i najsigurniji put. Zapamti, u avgustu 2026. pobijedit će oni koji su svoj sistem ‘uzemljili’ u etiku i transparentnost, a ne oni sa najbržim procesorima. Ne gubi vrijeme na marketing, sredi svoju bazu podataka odmah.