Odakle dolazi Claude? Sve o Anthropic poreklu i timu

Prestanite gutati marketinške priče o magičnim botovima

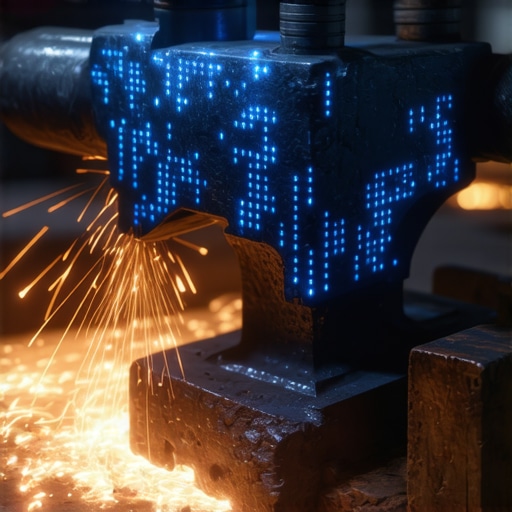

Mislite da je Claude samo još jedna ‘pametnija’ verzija ChatGPT-a? Varate se. To je kao da kažete da je profesionalni Milwaukee udarni odvijač isto što i dječija plastična igračka jer oba imaju dršku. Ako mislite da AI nastaje tako što se ‘kod sam napiše’, niste vidjeli kako se u radionici Anthropic-a kuju algoritmi. Prava istina je mnogo prljavija i stresnija. Vi se oslanjate na ove modele svakodnevno, a ne znate da je Anthropic nastao iz čistog straha i pobune protiv neodgovornog ‘kucanja koda’ bez osigurača. Vaši podaci i vaša sigurnost ovise o tome ko drži pajser u toj firmi.

Razvod koji je potresao Silicijumsku dolinu: Krv, znoj i kod

Zaboravite na ‘glatku saradnju’. Anthropic nije nastao uz kafu i osmijehe. Nastao je kada su Dario i Daniela Amodei 2021. godine, zajedno sa još devet ključnih inženjera, bukvalno razvalili vrata OpenAI-a i izašli vani. Zašto? Jer su vidjeli da se juri za profitom dok su sigurnosni protokoli ostavljeni da skupljaju prašinu. Zamislite da gradite neboder, a vaš šef odluči da izbaci armaturu iz temelja samo da bi završio sprat brže. To je bio OpenAI u očima osnivača Anthropic-a. Uzeli su svoje znanje, oštre jezike i odlučili napraviti sistem koji se neće srušiti na glavu korisnika. Brujanje servera u njihovim prvim kancelarijama nije zvučalo kao inovacija; zvučalo je kao priprema za rat za AI etiku.

Da li je Claude zaista sigurniji ili je to samo PR trik?

Direktan odgovor: Claude je dizajniran da kaže ‘ne’ tamo gdje bi drugi modeli ‘pukli’ pod pritiskom. Dok drugi modeli uče na principu ‘udovolji korisniku po svaku cijenu’, Claude ima ugrađen ‘ustav’. To nije metafora. To je hardkodirani set pravila koji sprečava model da postane toksičan. Ako mu zatražite nešto opasno, on neće okolišati. Odbit će vas hladno i precizno. To je kao onaj stari majstor u radionici koji vam neće dati da koristite cirkular bez zaštitnih naočala, bez obzira koliko se vi žalili da vam smetaju.

Nauka o materijalima: Zašto Constitutional AI mijenja pravila igre?

U ovoj sekciji moramo stati i objasniti fiziku iza koda. Većina AI modela koristi RLHF (Reinforcement Learning from Human Feedback). To je kao da dresirate psa dajući mu keks svaki put kad sjedne. Problem? Pas će sjediti i kad ne treba samo da dobije keks. Anthropic je uveo Constitutional AI. Umjesto da hiljade slabo plaćenih radnika klikću na ‘dobar’ ili ‘loš’ odgovor, oni su Claude-u dali listu principa (Ustav) i natjerali ga da sam kritikuje svoje odgovore. To je proces koji miriše na ozon i spaljenu elektroniku od silnog procesiranja. Model prolazi kroz fazu ‘samootriježnjenja’ gdje odbacuje sve što krši pravila privatnosti i etike. To je razlika između lijepljenja selotejpom i pravog varenja čelika. Bond (veza) je molekularno jači.

UPOZORENJE: Nikada ne unosite povjerljive poslovne ugovore u bilo koji javni AI model bez provjere lokalnih GDPR regulativa. Čak i najsigurniji model može ‘procuriti’ ako ga koristite kao kantu za smeće za svoje tajne. Šok od gubitka podataka peče jače od 220V.

Anatomija kvara: Šta se desi kada AI nema ‘kočnice’

Ako preskočite razumijevanje porekla Anthropic-a, osuđeni ste na katastrofu u 2026. godini. Zamislite scenario: koristite AI za automatizaciju korisničke podrške. Model bez ‘ustava’ (kao stariji GPT modeli ili loši open-source klonovi) može početi da halucinira i nudi popuste od 99% samo da bi usrećio kupca u tom trenutku. Šest mjeseci kasnije, vaša firma je u bankrotu. To je ‘Anatomija kvara’. Anthropic je ovaj problem riješio tako što je Claude-u ugradio ‘kočioni sistem’ koji provjerava logičku konzistentnost svake rečenice prije nego što je ispljune na vaš ekran. Ako rečenica ne drži vodu, Claude je briše. To je naporno, usporava proces za milisekunde, ali spašava vaš novčanik. Loš kod je kao trula daska – naizgled je u redu dok na nju ne stanete svom težinom.

Zašto je tim Amodei porodice toliko bitan?

Dario Amodei nije teoretičar iz bjelokosne kule. On je čovjek koji razumije skalu. Radio je u Google Brain-u i OpenAI-u na pozicijama gdje se ne pišu ‘hello world’ programi, već se upravlja infrastrukturom koja troši struje kao manji grad. Njegova sestra Daniela donosi operativnu strogoću. U svijetu gdje svi pokušavaju ‘napraviti nešto na brzinu’, oni su oni dosadni tipovi koji insistiraju na duplim provjerama. Oni ne vjeruju u ‘move fast and break things’. Oni vjeruju u ‘build right or don't build at all’. To je mentalitet starog kovača koji zna da jedan vazdušni mjehur u odlivku znači da će mač puknuti u prvoj bitci.

Finansijski ubod: Ko zapravo plaća račune?

Ne budite naivni. Anthropic troši milijarde. Ali pogledajte ko investira: Amazon i Google. To nisu filantropi. Oni kupuju ‘sigurnost’ jer znaju da će regulatori u EU i SAD-u (poput EU AI Act-a iz 2026.) sasjeći svaku firmu koja koristi ‘divlji’ AI. Korištenje Claude-a je vaša polisa osiguranja. Platićete možda malo više po tokenu, ali nećete plaćati milionske kazne jer je vaš bot počeo vrijeđati klijente na nacionalnoj osnovi. Moj komšija je pokušao uštedjeti koristeći neki sumnjivi open-source model za svoj webshop; završio je sa tužbom za klevetu jer je bot ‘izmislio’ da je konkurentska firma pod istragom. Nemojte biti taj lik.

Zaključak radnog dana

Claude nije nastao u vakuumu. Nastao je kao reakcija na haos. Odvajanje od OpenAI-a, uvođenje Constitutional AI-a i insistiranje na sigurnosti iznad brzine su faktori koji Anthropic čine jedinim ozbiljnim izborom za profesionalce. Kada sjednete za tastaturu, zapitajte se: želite li alat koji će vam reći ono što želite čuti, ili alat koji je kovan da preživi najgore uslove i sačuva vaš integritet? Ja biram ovaj drugi. Armatura je možda skupa, ali bez nje ste samo vlasnik gomile šute nakon prvog potresa na tržištu. Zaboravite na lagane prečice. U AI svijetu, kao i u radionici, jedini put je onaj koji poštuje pravila struke. Radite pametno, ne samo brzo.