Siguran AI: Testiraj tačnost odgovora u 2 minuta [2026]

Laž o ‘nepogrešivom’ AI-u: Zašto tvoj model laže kao trgovac polovnjacima

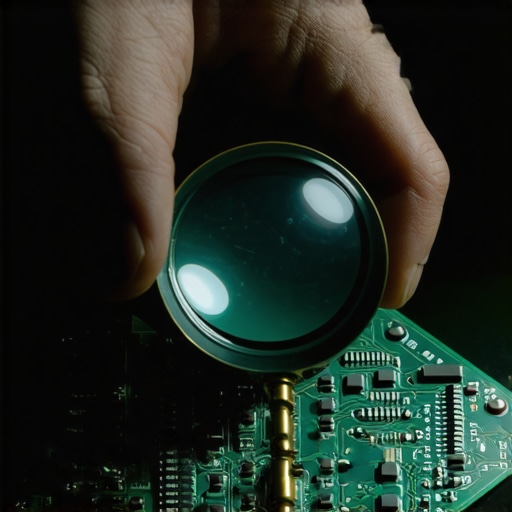

Prestani vjerovati marketinškim trikovima da je AI ‘pametan’. To je alat, baš kao i tvoj cirkular u radionici, a ako mu je oštrica tupa ili je motor ‘prosvirao’, samo ćeš upropastiti skupi materijal. Ti ili tvoj klijent ćete platiti cijenu te greške u stvarnom novcu ako ne naučiš kako da prepoznaš digitalni feler prije nego što pritisneš ‘Enter’. Čim vidiš odgovor koji zvuči previše ‘glatko’, tvoj alarm za škart treba da se upali. AI modeli ne znaju istinu; oni samo slažu vjerovatnoće, a to je recept za katastrofu ako radiš na nečemu što zahtijeva preciznost u milimetar.

Vidio sam stotine ‘stručnjaka’ kako gube sate popravljajući brljotine koje je generisao chatbot jer su bili lijeni da potroše 120 sekundi na testiranje. Ako ne želiš da tvoj projekat završi kao gomila beskorisne piljevine, moraš usvojiti protokol provjere koji ne oprašta. U naredne dvije minute naučit ćeš kako da iščupaš istinu iz algoritma i uštediš sebi dane bespotrebnog rada. Nema više nagađanja. Samo sirova, provjerena informacija.

Dva minuta istine: Protokol za detekciju digitalnog ‘felera’

Direktna instrukcija je jednostavna: nikada ne prihvataj prvi odgovor bez ‘stresa’ testa koji simulira ekstremne uslove logike. Prvi korak u tvojoj dijagnostici je Zero-Knowledge Test. Postavi AI-u pitanje o specifičnom detalju koji ti već znaš, ali ga namjerno uokviri pogrešno. Ako mašina ‘zagrize udicu’ i potvrdi tvoju laž samo da bi ti ugodila, znaš da imaš posla sa modelom koji pati od halucinacija. Takav alat je opasan. Pogledaj kako da smanjiš AI halucinacije odmah jer su one najčešći uzrok neuspjeha u 2026. godini.

Drugi korak je Logička petlja. Zatraži od modela da objasni proces unazad. Ako se koraci ne poklapaju sa početnim rezultatom, negdje u zupčanicima algoritma postoji ozbiljno trenje. Osjeti taj miris ‘spaljene’ logike. To je trenutak kada moraš stati. Baš kao što ne bi koristio napuknut čekić, nemoj koristiti ni neispravan odgovor. Često je problem u samom početku, pa je bitno da naučiš kako da popraviš loš prompt za 30 sekundi prije nego što potpuno otpišeš alat.

Da li stvarno moram provjeravati svaki odgovor?

Da, apsolutno moraš. Čak i najbolji modeli, poput onih koje koristiš kroz Aria AI, mogu pogriješiti pod pritiskom kompleksnih upita. Razmišljaj o tome kao o provjeri uglova na ramu za sliku – ako jedan pobjegne za stepen, cijela konstrukcija je nakrivo. AI je samo statistička mašina, a statistika ne mari za tvoje rokove ili tvoj ugled.

Problem ‘praznog hoda’: Zašto vjerovatnoća nije isto što i istina

Svaki put kada AI generiše rečenicu, on ne ‘razmišlja’, on se kocka. Ovo je Material Science sekcija tvog digitalnog treninga: LLM (Large Language Models) funkcionišu na bazi ‘tokena’ koji se nižu jedan za drugim na osnovu najveće šanse da se pojave zajedno. Zamisli to kao slaganje cigli bez maltera; na prvi pogled zid izgleda čvrsto, ali čim ga gurneš malo jače, sve se ruši. To je zato što model nema unutrašnji ‘kod’ za stvarnost, već samo za sintaksu. Ako mu zadaš zadatak koji zahtijeva duboko razumijevanje fizike ili prava, on će ‘izmisliti’ malter koji ne drži ništa.

U mojoj radionici, ako koristim PVA ljepilo, znam da ono prodire u vlakna drveta i stvara vezu jaču od samog drveta. AI ‘ljepilo’ je često samo površinska mrlja. On ‘zna’ da riječ ‘voda’ često ide uz ‘mokro’, ali ne razumije zašto. Zato su greške u mašinskom učenju tako suptilne i opasne. One ne vrište ‘ja sam greška’; one šapuću ‘ja sam istina’ dok te ne uvuku u problem. Ako ne razumiješ logiku probabilističkih modela, uvijek ćeš biti žrtva njihovog digitalnog blefa.

WARNING: Nikada ne unosi povjerljive poslovne podatke ili šifre u javne AI modele radi provjere tačnosti. 120v strujni udar može zaustaviti srce, a curenje poslovne tajne može trajno ugasiti tvoju firmu. Koristi samo anonimizirane setove podataka.

Anatomija katastrofe: Kako jedna kriva informacija ruši čitav projekat

Dozvoli da ti opišem jedan ‘škart’ koji sam vidio prošle jeseni. Kolega je koristio AI da izračuna statičko opterećenje za jednu platformu. Model je bio samouvjeren, dao je cifre do treće decimale. Čovjek je vjerovao mašini. Šest mjeseci kasnije, pod uticajem vlage i konstantnog pritiska, materijal je počeo da se zamara tamo gdje je AI rekao da će biti najčvršći. Zašto? Jer je model zanemario faktor ‘zamora materijala’ koji nije bio eksplicitno u promptu. Rezultat: 4.000 eura štete i sreća da niko nije povrijeđen. To je prava cijena slijepe vjere u kod.

Ako koristiš AI za pisanje koda, situacija je još gora. Jedna kriva zagrada ili pogrešno pozvana biblioteka može otvoriti rupu kroz koju će hakeri proći kao kroz širom otvorena vrata. Zato je kritično da znaš kako da zaštitiš svoj model od hakera. Ne budi onaj tip koji nauči lekciju tek kad mu radionica izgori. Testiraj, sumnjaj, i uvijek, ali uvijek, imaj fizičku potvrdu onoga što ti ekran kaže.

Zašto tvoj prompt smrdi: Popravi ulaz pre nego što okriviš mašinu

Sirova istina je da AI često griješi jer mu daješ ‘labave’ instrukcije. Ako mu kažeš ‘napravi mi plan’, to je kao da uđeš u prodavnicu alata i kažeš ‘treba mi nešto od metala’. Dobićeš smeće. Da bi dobio tačnost, moraš definisati parametre kao da pišeš vojni protokol. Koristi ‘Temperature’ parametar ako imaš pristup API-ju; postavi ga na 0.1 za činjenice, ili ga ‘odvrni’ za kreativnost. Ako ne znaš o čemu pričam, hitno pročitaj kako da podesiš temperature parametar za bolje rezultate.

Dobar prompt mora imati kontekst, ulogu i jasan izlazni format. Ako tražiš analizu, reci mu: ‘Djeluj kao senior inženjer sa 20 godina iskustva. Provjeri ove podatke naspram važećih standarda iz 2026. godine. Navedi izvore.’ Bez toga, on će samo ‘mlatiti praznu slamu’. Često vidim ljude kako koriste Perplexity AI umjesto Google-a, ali i tamo moraš znati kako da filtriraš buku. Loš ulaz jednako loš izlaz. To je zakon koji ne možeš zaobići.

Koji je najbrži način da uočim AI halucinaciju?

Najbrži način je da tražiš citate ili linkove. Ako AI ne može da navede izvor ili ako su linkovi ‘mrtvi’ (404 greška), bježi od tog odgovora glavom bez obzira. To je digitalni ekvivalent naprsline na nosivoj gredi. Ne pokušavaj to popraviti trakom; sruši sve i kreni ispočetka sa boljim izvorima informacija.

Code Check: Sigurnost podataka i digitalna higijena u 2026.

Direktna akcija: Odmah provjeri podešavanja privatnosti u svom AI interfejsu. Prema standardima iz 2026., većina firmi zahtijeva ‘opt-out’ iz trening setova kako bi se spriječilo da tvoji interni podaci postanu dio javnog znanja. To nije samo pitanje etike, to je pitanje opstanka. Ako tvoj klijent sazna da si njegove nacrte ‘ubacio’ u javni model, tvoja karijera je završena brže nego što možeš reći ‘upload’.

Uvijek koristi provjerene metode za prepoznavanje zloupotrebe podataka. Budi onaj koji postavlja standarde u svojoj branši, a ne onaj koji krpi rupe nakon što voda počne da nadire. Digitalna higijena je kao pranje ruku nakon rada sa toksičnim smolama – dosadno je, ali bez toga ćeš se otrovati. AI je tvoj najjači saveznik samo ako ga držiš na kratkom lancu i pod stalnim nadzorom. Sada uzmi taj alat, testiraj ga onako kako sam te naučio, i završi taj posao kako treba. Bez felera. Bez laži. Samo čist rad.