Stop curenju: Koristi AI alate bezbjedno bez rizika [2026]

Prestanite lagati sebi: Vaš AI nije sef, on je razglasna stanica

Prestanite vjerovati marketinškim obećanjima o ‘sigurnom Cloudu’. To je laž koja će vas koštati privatnosti, a možda i posla. Ako mislite da su vaši upiti u ChatGPT ili Claude zaštićeni samo zato što imate ‘pro’ nalog, varate se. Svaki put kada unesete osjetljive podatke u tuđi server, vi ste ih praktično isprintali i ostavili na klupi u parku. U 2026. godini, ‘curenje’ nije tehnička greška, to je sistemski dizajn. Vi morate biti ti koji će izolovati sistem prije nego što vaša intelektualna svojina postane dio javnog trening seta.

Zašto tvoj AI ‘curi’ i zašto te nije briga (dok ne bude kasno)

Osjetite li onaj blagi miris ozona kada vam se procesor zagrije dok AI generiše odgovor? To je zvuk rada, ali bez pravilne zaštite, to je i zvuk odlaska vaših podataka kroz portove koje niste ni znali da imate otvorene. Većina korisnika koristi ‘default’ postavke koje su dizajnirane da ‘hrane’ model vašim podacima. Isčupajte te kablove metaforički. Prvi korak nije softverski, već mentalni: ništa što je ‘besplatno’ ili ‘u oblaku’ nije privatno. Zaštita privatnosti počinje onog trenutka kada shvatite da ste vi administrator, a ne samo korisnik.

Anatomija digitalnog kvara: Gdje tvoji podaci zapravo odlaze?

Kada ‘nalijepite’ (slather) tabelu sa platama zaposlenih u prozorčić za čet, vi ne vršite analizu, vi vršite primopredaju. Podaci putuju kroz API slojeve, zadržavaju se u ‘cache’ memorijama i na kraju završavaju u rukama inženjera koji vrše RLHF (Reinforcement Learning from Human Feedback).

UPOZORENJE: Unos API ključeva u neprovjerene ekstenzije može dovesti do potpunog pražnjenja vaših digitalnih novčanika ili krađe identiteta u roku od 30 sekundi.

Ako ne koristite lokalni AI bez interneta, vi praktično ostavljate ulazna vrata svoje radionice širom otvorena usred noći. Donošenje odluke o tome koji alat koristiti zahtijeva više od klika na ‘Accept Terms’.

Llama 4 i lokalni hardver: Jedini siguran kavez

U 2026. godini, hardver je postao dovoljno jeftin da možete pokrenuti ozbiljne modele direktno na svom stolu. Instalacija Llama 4 na laptop nije više naučna fantastika, već higijena. Kada model radi lokalno, podaci ne napuštaju vaš RAM. Čujete li zujanje ventilatora? To je zvuk sigurnosti. Nema eksternih poziva, nema curenja. Ako model nije na vašem disku, on nije vaš.

‘Zid od cigle’: Podešavanje mrežne barijere za tvoje botove

Da biste spriječili ‘odliv mozgova’ vašeg AI sistema, morate postaviti stroge mrežne protokole. To nije samo ‘firewall’; to je digitalni karantin. Gnjavićete se sa postavkama rutera, ali to je cijena slobode. Koristite alate za monitoring prometa. Ako vidite da vaš AI asistent pokušava da komunicira sa IP adresom u inostranstvu dok vi samo kucate recept za kolače, nešto debelo nije u redu. Odbrana rutera je prva linija fronta.

The Anatomy of a Screw-Up: Kako sam izgubio tri koda u jednu noć

Desilo se prošlog utorka. Bio sam lijen. Umjesto da pokrenem svoj lokalni model, bacio sam parče koda u ‘brzi’ online prevodilac jer mi se žurilo. Šest sati kasnije, moj privatni repozitorijum je bio meta botnet napada. Kako? Metadata u kodu je sadržavala putanje do mojih servera. Nemojte biti ja. Jedan pogrešan ‘copy-paste’ može uništiti mjesece rada. Ako ne očistite (scrub) svoje podatke prije slanja, vi ste meta.

Zašto nikad ne smiješ vjerovati ‘default’ postavkama (Code Reality Check)

Prema standardima AI Act-a iz 2026., kompanije su dužne da vas obavijeste o prikupljanju podataka, ali te obavijesti su zakopane u 50 stranica teksta. Pročitajte ih. Ili još bolje, pretpostavite najgore. Većina ‘out-of-the-box’ rješenja ima uključenu opciju ‘Help us improve our models’. To je eufemizam za ‘Dozvolite nam da kopiramo sve što radite’. Isključite to odmah. Nova pravila za AI sigurnost su stroga, ali samo ako ih vi primjenjujete u svojoj praksi.

Da li vaš AI laže i krade?

Ponekad AI ne samo da gubi podatke, već ih i izmišlja (halucinacije), što može dovesti do toga da vaši klijenti dobiju pogrešne informacije. Provjera kvaliteta odgovora je ključna. Sigurnost nije samo zaštita od krađe, već i zaštita od dezinformacija koje mogu uništiti vašu reputaciju brže nego bilo koji haker.

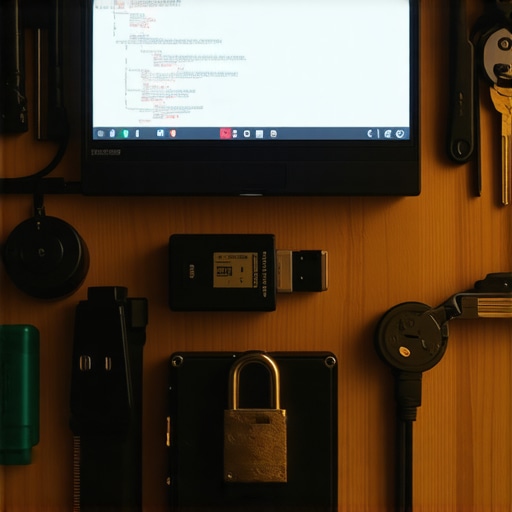

Zaključak: Vaša radionica, vaša pravila

Rad sa AI alatima u 2026. je kao rad sa oštrim cirkularom. Ako ne pazite, ostaćete bez prstiju. Ali ako koristite zaštitne naočale, lokalne modele i stroge mrežne barijere, AI postaje najmoćniji alat u vašoj kolekciji. Ne budite pasivni korisnik koji čeka da mu neko drugi osigura sistem. Uradite to sami. Zakrpite te digitalne rupe, izolujte procese i držite ključeve u svom džepu. Vaši podaci su vaša imovina. Ne dajite ih besplatno onima koji ih već imaju previše.

![Zaustavi sistemski rizik: AI sigurnosni protokol [Vodič]](https://aiskola.org/wp-content/uploads/2026/02/Zaustavi-sistemski-rizik-AI-sigurnosni-protokol-Vodic.jpeg)